El rival más débil fue un formato de televisión en el que los concursantes, dispuestos en forma de semicírculo, debían decidir con sus votos cuál de sus contrincantes tenía el nivel más bajo y por tanto debía ser eliminado tras cada ronda de preguntas. Fue un programa de gran éxito en el Reino Unido que se adaptó en España durante dos temporadas a principio de siglo y, además de eso, también un escenario de experimentación social. En 2012, investigadores británicos de la universidad de Lincoln presentaron en Granada los resultados de un estudio, basado en este concurso, en el que afirmaban que el ser humano podría estar, de algún modo, programado para tratar bien a sus vecinos.

Para afirmar semejante cosa, los académicos se basaban en el análisis cuantitativo de las decisiones de los concursantes. Cuando uno de ellos fallaba muchas más preguntas que los demás, su expulsión se daba por segura. Es cuando había coincidencia en el número de errores cuando entraban en juego los patrones de comportamiento que explicó la universidad en su nota de divulgación: "Obligada a tomar una decisión, el estudio revela que la gente es menos propensa a expulsar a los concursantes situados a su lado y suele elegir como blanco a otros que se encuentran más lejos".

No es la primera vez que se documenta este efecto, comúnmente conocido como de 'evitación del vecino'. Ya en los años 60 otro trabajo, conducido por Stanley Milgrim en la Universidad de Yale, constató que sus participantes consentían, hasta cierto punto, que sus errores al responder preguntas derivasen en descargas eléctricas (que ellos no sabían que eran fingidas) a otra persona, situada en otra sala y a la que, por tanto, no podían ver, aunque sí escuchar.

Un entorno seguro

Y es algo, en ese sentido, similar a lo que ocurre día tras día en las redes sociales en las que el discurso del odio se propaga como la pólvora: leemos (en Twitter) o incluso vemos (en Facebook o Instagram), pero no sentimos del todo. El concepto de cercanía atribuido a las redes sociales es más una ilusión que una realidad. El anonimato y la distancia física, que genera otra emocional, provocan una reducción de la empatía y la sensación de peligro y propician un contexto en el que nos sentimos seguros para decir cualquier cosa sin temer por nuestra integridad.

La gente piensa que está hablando en un círculo reducido cuando es una comunicación pública a la que todo el mundo puede acceder"

"Hay gente que no llega a comprender bien la tecnología que usa", señala Homero Gil de Zúñiga, director del laboratorio Media Innovation de la Universidad de Viena e investigador asociado de la Universidad de Princeton. "Piensan que están hablando en un círculo reducido cuando es una comunicación pública a la que todo el mundo puede acceder", explica el profesor, que considera superada la tesis de que sólo el anonimato está detrás del tono que se emplea en las redes: "Se hablaba de ello al principio, pero también hay muchas personas que no son anónimas y se comportan igual". La profesora Amparo López Meri, de la Universidad Jaume I de Castellón, plantea sin embargo que "los políticos y periodistas, pese a reconocer que en ocasiones se usa el anonimato para la descalificación, destacan que los beneficios que aportan las redes sociales son mayores que los riesgos".

Gil de Zúñiga recupera los estudios sobre la distancia física referidos en este artículo, e incorpora otro más: el que analiza la comunicación de los conductores en situaciones tensas cuando están al volante y cuando se encuentran fuera de su vehículo. Y lo extiende a la conversación social, para explicar la desinhibición que nos conquista cuando nos expresamos en la red: "Puede haber una sensación de protección, derivada del hecho de estar en casa y relajado detrás de una pantalla".

En esa línea, es probable que el usuario que mandó a Rita Barberá el pasado miércoles "a pasar caloret al infierno" no se lo repetiría a la cara a su familia en el funeral. Ni tampoco el que interpeló ese mismo día a Pablo Iglesias fantaseando con dar un golpe de Estado para "fusilar a todos los de tu calaña", ni los otros tantos que han convertido Twitter en el tipo de red social que Disney no quiso adquirir hace poco más de un mes, negándose a asociar su marca con la de una plataforma en la que los trolls campan con escasa vigilancia.

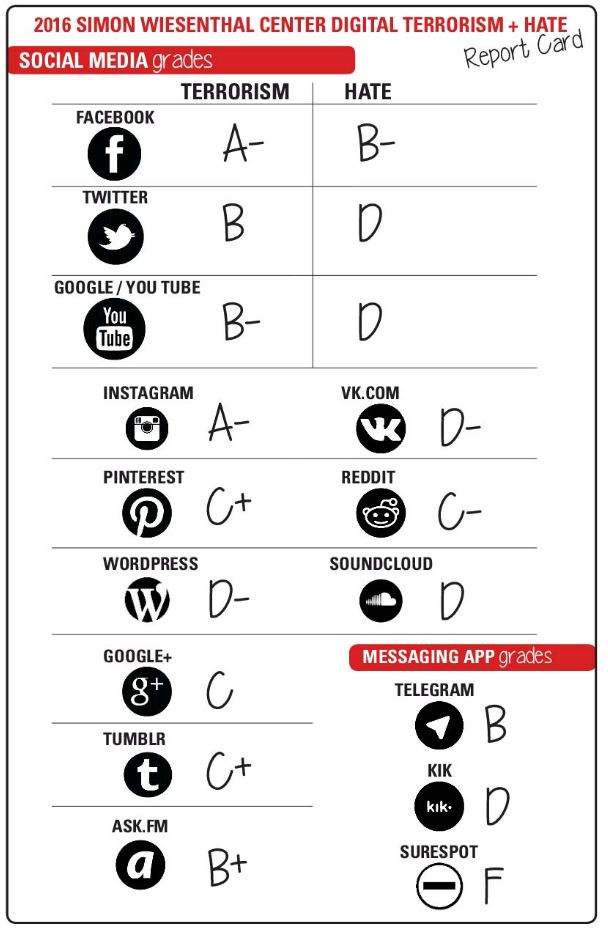

Tan poca que Twitter es la segunda peor red social en términos de prevención del odio, sólo por delante de la rusa VK, según el estudio anual elaborado por el centro Simon Wiesenthal, dedicado a la vigilancia global del antisemitismo en las redes y las instituciones. "Twitter ha hecho muy poco para frenar el odio", denuncia a El Independiente Abraham Cooper, decano asociado de la institución y una de las voces más respetadas de la comunidad judía norteamericana: "Radicales de todo el mundo todavía confían en la herramienta como un componente importante para distribuir su mensaje".

Ranking de redes sociales elaborado por el centro Simon Wiesenthal en términos de difusión del Terrorismo y el Odio.

Una misión, la que dirige Cooper, no por casualidad calcada a la de la Coalición Interparlamentaria para el Combate del Antisemitismo (ICCA, por sus siglas en inglés), que reúne periódicamente a un grupo de trabajo dedicado a la identificación de amenazas y la búsqueda de soluciones al discurso del odio en las redes sociales. "El odio en internet es un grave desarrollo de los últimos tiempos, y mientras el avance de la tecnología ha hecho del mundo un lugar más pequeño, la propagación simplificada del odio y la incitación es al mismo tiempo un problema seriamente peligroso que debe ser abordado", establecía el grupo como punto de partida tras una de sus reuniones, celebrada en Londres.

Realidades diferentes

En el documento emanado de ella, el ICCA definía la propagación del odio en las redes como "especialmente pernicioso", debido a que el contenido "puede expandirse a una audiencia enorme cuya relación con el propagador es simplemente tangencial". Esto es: un retweet que se cuela en un timeline, un 'me gusta' que de repente aparece en un muro. Es precisamente ese el factor que da relevancia al fenómeno, pese a que las cifras expresadas en frío equiparen el abuso virtual con el que se produce en directo.

Por ejemplo: el programa Stop Bullying del gobierno norteamericano precisa que el 70,6% de los jóvenes estadounidenses ha presenciado casos de acoso en sus centros escolares; mientras que, en el mismo país, el Centro para la Innovación en la Investigación de la Salud Pública (CFIPHR) cifra en el 72% el porcentaje de la población que ha sido testigo de abusos en internet.

La magnitud de los casos y la enorme cantidad de usuarios de las redes sociales dificultan, técnica y económicamente, el control efectivo sobre el discurso del odio

Sin embargo, las dimensiones del último son muy distintas: basta la participación de un influencer para que un caso de acoso online se haga viral e involucre en él a miles de personas en cuestión de minutos, forzando soluciones tan injustas como la que obligó a la actriz Leslie Jones a abandonar Twitter este verano, por el mero hecho de que a un importante número de usuarios les pareciese censurable (instigados por una crítica en el portal Breitbart, que dirige el estratega-en-jefe de Donald Trump, Steve Bannon) que una negra protagonizase Cazafantasmas.

En su documentación de casos de este tipo, el ICCA tampoco ahorraba en ejemplos, sumamente explícitos: "El grupo de Facebook Día de Matar a un Judío declaró el 4 de julio de 2010 como el inicio de un período de 18 jornadas de violencia 'en cualquier lugar donde veas a uno'. El contenido del grupo incluía esvásticas, fotos de cadáveres apilados y comentarios de miembros que 'no podían esperar para empezar a violar a bebés judíos'", detallaba.

Es una muestra extrema de un contenido que contraviene a las propias normas de uso de las redes, a la legislación de prácticamente cualquier país en el mundo y que sería objeto de condena segura de publicarse en un medio de comunicación. En internet, sin embargo, las opciones de que quede impune son grandes, en parte debido a un problema que el propio ICCA reconocía como irresoluble: "Hay una cantidad enorme de material de este tipo en las páginas que actúan como intermediarias, una cantidad tan grande que es simplemente imposible controlarla toda, a la vez que se mantiene un modelo de negocio que permita a las compañías entrar o mantenerse en el mercado online". Basta atender a las cifras de usuarios para comprobar que, aunque sólo una mínima fracción de ellos se dedicara a generar contenido de este tipo, sería francamente difícil ponerle coto: Facebook, 1.700 millones; Instagram, 500; Twitter, más de 300.

La fina línea de la censura

El organismo abordaba otro reto, quizá el más relevante de entre los que contribuyen a añadir dificultad a la lucha contra estos sucesos: la línea del delito, igual que la del odio, no siempre está tan clara. Varios kilómetros de distancia separan el deseo fehaciente de violar a bebés judíos muertos de los chistes sobre el fallecimiento de un personaje público. El contexto, como quedó claro en el juicio de la Audiencia Nacional al concejal madrileño Guillermo Zapata, exige un análisis sesudo que obliga a participar en el proceso a seres humanos y no sólo a máquinas y algoritmos. Un problema que se adhiere al anterior: "El volumen de quejas recibidas provoca que los revisores puedan tener sólo unos segundos para tomar una determinación histórica, contextual, política y social sobre el mensaje que tienen enfrente", lamentaba el grupo de trabajo del ICCA.

Las compañías hacen poco por solucionar el dilema: "Es una batalla que prefieren perder"

Los gestores de las plataformas son conscientes de estas limitaciones y, de hecho, hacen poco para solucionar el dilema. "Es una batalla que prefieren perder", apunta el profesor Gil de Zúñiga, para quien las redes "seguramente" tienen la capacidad técnica y operativa de controlar todos sus contenidos, pero no las ganas de responder a la pregunta principal: "¿A qué precio?"

"La sociedad prefiere a un culpable libre que a un inocente en la cárcel", utiliza el experto para ilustrar una línea difusa, que los intermediadores podrían cruzar con cierta arbitrariedad: "El problema del control es que, en muchas ocasiones, degeneraría en censura". En ese sentido, Alejandro Touriño, socio del bufete ECIJA y uno de los abogados especializados en derecho en la red más relevantes de nuestro país, considera por su parte que "aplicar la ley a quien infringe cualquier derecho no significa censura, sino ejecución de las normas que nos rigen".

En cualquier caso, para evitar esa sombra, las empresas como Twitter han decidido establecer otra estrategia: darle al acosado las herramientas para que ignore el abuso, pero no combatirlo en su origen. En este sentido, las nuevas normas de seguridad de la compañía no hacen nada nuevo por impedir que un usuario infrinja las normas de uso, pero sí facilitan que el receptor silencie u omita ciertos términos que le puedan resultar molestos. Volviendo a la comparación escolar: un "no les hagas caso" trasladado a la red.

"La solución al problema nunca puede provenir del lado de la víctima sino del infractor", critica al respecto Touriño, que precisa que "no basta con obviar cualquier abuso o bloquear al autor de los hechos", sino que la línea de actuación debe basarse en "identificar al usuario y enjuiciar los hechos de acuerdo a la legislación vigente en cada momento".

"Es una solución cómoda", valora igualmente la profesora López Meri, que considera además que para las redes "establecer trabas previas a la publicación de mensajes es peligroso desde el punto de vista de la libertad de expresión", aunque sí reclama que se podrían "endurecer los criterios para identificarse y crear una cuenta". Eso, sin embargo, plantea una última cuestión a las empresas, más económica que moral: se traduciría en menos usuarios, y de inicio en un menor valor publicitario ante los anunciantes.

Un dolor de cabeza añadido para una compañía como la que dirige Jack Dorsey, que ya experimenta serios problemas para monetizar su ingente flujo de actividad. Un "todo vale", como describe Gil de Zúñiga, fácilmente traducible: es más rentable perder a un acosado que a 10.000 acosadores. "Tendremos este problema con nosotros durante mucho tiempo", denuncia el rabino Cooper, "y no lo superaremos sin la participación activa de las compañías".

Te puede interesar

Lo más visto